- Admin

- Posts de Forum 72 338

18 mars 2024 à 13:23:05 via site

18 mars 2024 13:23:05 via site

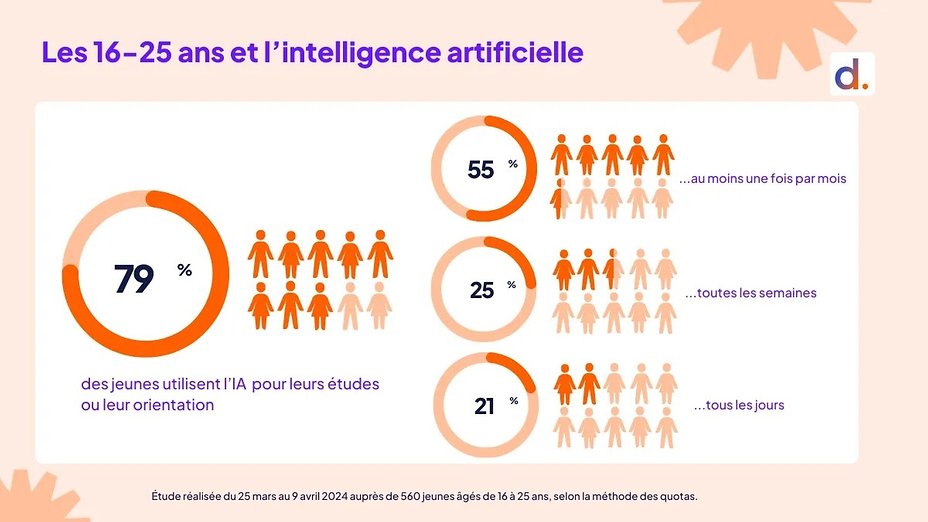

⏩️La Commission de l'IA recommande de moderniser la CNIL⏪️

La Commission de l'IA publie une liste de recommandations pour faire du pays, un champion mondial en la matière, au point de moderniser la CNIL pour faciliter l’accès à nos données santé, est-ce que c'est vraiment ça être un champion ?

La Commission interministérielle de l’intelligence artificielle de France vient de publier une liste de recommandations en 6 axes pour faire du pays un champion en la matière à l’échelle mondiale. C’est une espèce de redite après l’annonce, par Emmanuel Macron, d’un investissement de 500 millions d’euros visant à faire de la France un pôle européen de l’intelligence artificielle ou encore après celle de la mise à disponibilité d’une enveloppe de 2 milliards d’euros pour la formation d’un nombre plus important de talents en intelligence artificielle

- Lancer immédiatement un plan de sensibilisation et de formation de la nation : animation de débats publics en continu sur les impacts économiques et sociétaux de l’IA au plus près des lieux du quotidien, structuration de l’offre de formation d’enseignement supérieur, massification de la formation continue aux outils d’IA, intégration de l’IA comme objet et outil du dialogue social

Réorienter structurellement l’épargne vers l’innovation et créer, à court terme, un fonds « France & IA » de 10 Md€, pour financer l’émergence de l’écosystème d’IA et la transformation du tissu économique français

Faire de la France un pôle majeur de la puissance de calcul : approvisionnement collectif sécurisé d’ampleur nationale et européenne, appel à projets d’implantation de centres de calcul avec garantie publique d’utilisation et simplification des procédures, crédit d’impôt IA pour l’entraînement de modèles

- Faciliter l’accès aux données : en matière de données à caractère personnel, modernisation du mandat de la Commission nationale de l’informatique et des libertés (Cnil) et de son collège, suppression de certaines procédures d’autorisation préalable d’accès aux données de santé et réduction des délais de réponse

En matière culturelle, mise en place de l’infrastructure technique favorisant l’entraînement des modèles d’IA dans le respect des droits de propriété intellectuelle

Assumer le principe d’une « exception IA » dans la recherche publique : libération des chercheurs des contraintes administratives, revalorisation de leur rémunération, doublement des moyens de la recherche publique spécialisée en IA

Promouvoir une gouvernance mondiale de l’IA : création d’une Organisation mondiale de l’IA pour évaluer et encadrer les systèmes d’IA, d’un Fonds international pour l’IA au service de l’intérêt général et d’un mécanisme de solidarité « 1 % IA » pour les pays en voie de développement.

🍃Des recommandations qui encore une fois veulent redéfinir l’accès à nos données personnelles de santé, on en reparlera !!

https://www.nextpit.fr/forum/823999/securite-et-confidentialite-en-actualites/page/2#3490618

— Modifié le 18 mars 2024 à 14:36:18

Keep Calm and Love Android.

Contenu éditorial recommandé

Avec ton accord, un contenu externe est chargé ici.

En cliquant sur le bouton ci-dessus, tu acceptes que des contenus externes soient affichés. Des données personnelles peuvent alors être transmises à des fournisseurs tiers. Tu trouveras plus d'informations à ce sujet dans notre Déclaration de protection de données.