Audio Overview est alimenté par le modèle NotebookLM de Google, un assistant d’intelligence artificielle spécialisé doté de capacités d’analyse de documents et de sites web plus avancées que celles de Gemini. Ce modèle alimente également le récapitulatif 2024 de Spotify.

Audio Overview s’étend à la recherche approfondie

Google a présenté pour la première fois l’année dernière l’aperçu audio avec Daily Recap, qui permet aux utilisateurs de générer des résumés de type podcast hébergés par l’IA à partir de sources Web et d’articles. Aujourd’hui, la fonctionnalité s’étend à la prise en charge des documents, notamment les PDF et les articles de recherche, grâce à Deep Research, qui a récemment été intégré à Gemini.

Les utilisateurs peuvent accéder à Audio Overview de Deep Research directement dans l’application Gemini sur mobile. Après avoir généré une étude ou un document de recherche, il suffit d’appuyer sur le fichier et de sélectionner « Générer un aperçu audio » dans le menu pour lancer la fonctionnalité. La même fonctionnalité est également disponible via Deep Research sur le web.

Pour l’instant, la génération d’aperçus audio à partir de documents est limitée à Deep Research sur mobile et sur le web. Nous avons testé la fonctionnalité dans l’application Gemini, mais elle n’a pas fonctionné pleinement, bien qu’un message ait indiqué que l’aperçu audio était en cours de création. Il est probable que Google étende la prise en charge dans un avenir proche. La fonctionnalité est déjà déployée pour les utilisateurs de Gemini et Gemini Advanced, mais n’est actuellement disponible qu’en anglais.

Gemini devient collaboratif

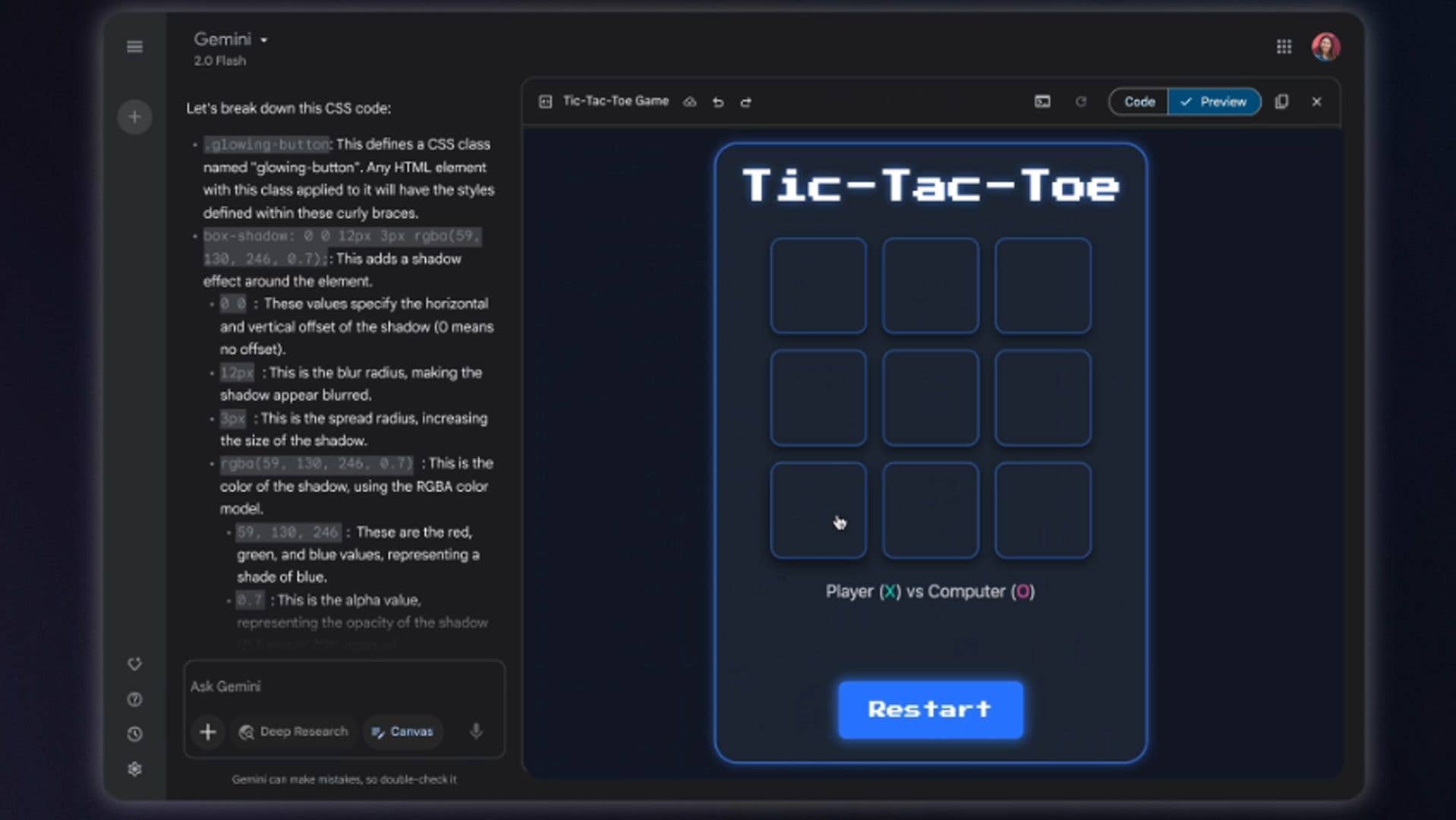

Canvas est un ajout majeur à Gemini, un espace de travail collaboratif conçu pour l’édition de documents en temps réel, le codage interactif et les prévisualisations assistées par ordinateur.

Pour les projets textuels, les utilisateurs peuvent rédiger et éditer des documents tout en tirant parti des outils d’ajustement de Gemini, qui permettent d’ajuster le ton, de raccourcir les phrases et de modifier le style. En outre, Gemini propose des suggestions d’édition pour améliorer la qualité de l’écriture. Les résultats de Canvas peuvent également être partagés pour la collaboration via Google Docs.

Google améliore également les capacités de codage de Gemini avec Canvas. Cet espace de travail permet aux utilisateurs de générer, de prévisualiser et de tester le code directement, sans avoir à recourir à des simulateurs ou à des applications de codage distinctes. Les formats pris en charge comprennent les applications web comme HTML et React, les scripts Python, les jeux et d’autres simulations.

En outre, Canvas peut être un outil précieux pour apprendre à coder, car il fournit des aperçus et des explications en temps réel sur des chaînes de code et des extraits spécifiques.

Canvas est désormais disponible sur Gemini Web pour les utilisateurs de base et premium. Il prend en charge toutes les langues dans lesquelles les applications Gemini sont actuellement proposées.

Si les nouvelles mises à jour de Gemini rendent l’IA plus flexible, elles ajoutent également de la complexité à l’expérience globale, la rendant moins rationalisée par rapport à un chatbot unique comme ChatGPT. Néanmoins, ces caractéristiques apportent une fonctionnalité précieuse. Mais qu’en pensez-vous?